Les rumeurs quIntel se relancerait dans le marché des processeurs graphiques de haute performance ne datent pas dhier, leur confirmation na donc étonné personne. Intel a accepté de se mettre à table pour décrire un peu plus ses plans. Lune des premières confirmations est que le projet est très loin de Larrabee, une variante des processeurs Intel avec énormément de curs qui aurait pu se transformer en carte graphique (vers 2010) et qui aura fini en Xeon Phi.

Les rumeurs quIntel se relancerait dans le marché des processeurs graphiques de haute performance ne datent pas dhier, leur confirmation na donc étonné personne. Intel a accepté de se mettre à table pour décrire un peu plus ses plans. Lune des premières confirmations est que le projet est très loin de Larrabee, une variante des processeurs Intel avec énormément de curs qui aurait pu se transformer en carte graphique (vers 2010) et qui aura fini en Xeon Phi.

Intel ne part pas de rien : la société dispose déjà de puces graphiques à basse consommation, intégrées dans la majorité de ses processeurs. Une technique assez simple pour produire des cartes de plus haute performance serait daugmenter le nombre de curs de ces puces, mais Intel a dautres plans en tête. Cette nouvelle génération sera prévue pour des tâches daffichage 3D et de calcul parallèle (dont apprentissage profond), tant pour des PC de bureau que pour des serveurs : dans ce genre de cas, les décisions prises pour les puces intégrées ne se révéleraient sûrement pas adaptées (puisquelles sont adaptées pour une très faible consommation dénergie).

Néanmoins, Intel souhaite se distinguer de la concurrence, ne pas seulement concourir sur le prix, la performance et la consommation, mais aussi sur les fonctionnalités reste à savoir ce quelles seront. Intel indique explicitement quil ny aura pas de norme propriétaire (en rappelant que le premier processeur graphique entièrement compatible avec DirectX 12 venait dIntel). Serait-ce une révolution similaire au lancer de rayons promu par NVIDIA et Microsoft ?

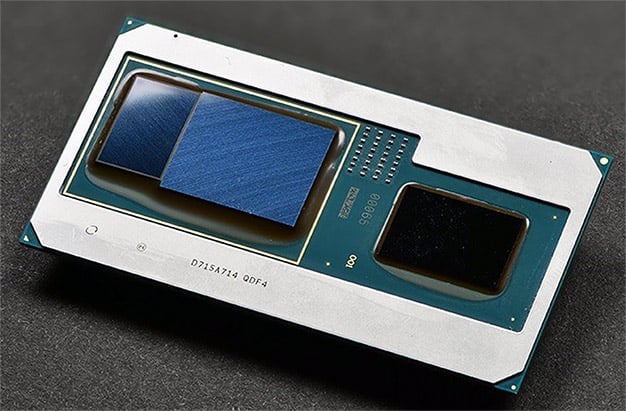

Au niveau de la performance, par exemple, Intel indique que les premiers modèles seront là pour prendre de la vitesse et lancer la gamme (ce sera un marathon, pas un sprint selon Ari Rauch) : on peut sattendre à voir des cartes sous la barre des trois cents euros. Des puces graphiques seront aussi sûrement intégrées aux processeurs centraux, comme les séries G actuellement, qui prennent un processeur principal Intel et une puce graphique AMD.

Intel met laccent sur la mise à léchelle de son architecture, pour passer dune très faible consommation à une très haute performance. Peut-être aura-t-on droit à une solution comme le SLI de NVIDIA ou le CrossFire dAMD, mais Intel refuse de savancer pour le moment.

Source : Intel Exec Discloses Discrete GPU Details And Strategy.