Les processeurs actuels sont principalement limités par leur consommation énergétique : il nest pas possible de garder tous les transistors dune même puce allumés simultanément, car la densité dénergie est beaucoup trop importante chaque millimètre carré consomme trop dénergie, la puce brûlerait à coup sûr sans désactiver des parties. Ce phénomène a conduit à la notion de silicium noir, cest-à-dire les parties qui ne peuvent pas être utilisées à un instant donné dans un processeur. Un domaine de recherche dans les semiconducteurs concerne donc la création de transistors qui consomment nettement moins dénergie (et donc dissipent moins de chaleur).

Les processeurs actuels sont principalement limités par leur consommation énergétique : il nest pas possible de garder tous les transistors dune même puce allumés simultanément, car la densité dénergie est beaucoup trop importante chaque millimètre carré consomme trop dénergie, la puce brûlerait à coup sûr sans désactiver des parties. Ce phénomène a conduit à la notion de silicium noir, cest-à-dire les parties qui ne peuvent pas être utilisées à un instant donné dans un processeur. Un domaine de recherche dans les semiconducteurs concerne donc la création de transistors qui consomment nettement moins dénergie (et donc dissipent moins de chaleur).En 1961, des chercheurs dIBM ont déterminé une limite absolue dans la consommation dénergie dun transistor (la limite de Landauer) : en effet, dun point de vue thermodynamique, la bascule dun transistor nest pas réversible, ce qui saccompagne inévitablement de pertes dénergie (en application de la seconde loi de la thermodynamique). Cette valeur a été déterminée comme trois zeptojoules (3 10^-21 joules). A contrario, des transistors actuels optimisés pour la consommation dénergie se placent au niveau de la picojoule, cest-à-dire 10^-12 joules, soit un milliard de fois plus que le minimum théorique (!), pour la réalisation de puces mémoire magnétiques par transfert de spin (STT-MRAM). Les transistors plus courants consomment encore plus dénergie.

En 2012, une équipe allemande a, pour la première fois, démontré expérimentalement que cette limite inférieure de consommation pouvait être atteinte. Ils ont, pour ce faire, utilisé une pince optique pour déplacer des perles de verre de deux microns de large (similaires à des bits) entre deux puits de potentiel. Une équipe américaine vient de montrer un résultat similaire, mais bien plus directement applicable à lélectronique : ils ont directement manipulé des bits faits daimants à léchelle nanométrique. Ce genre daimants est déjà à la base des disques durs magnétiques actuels, mais également des mémoires de type STT-MRAM.

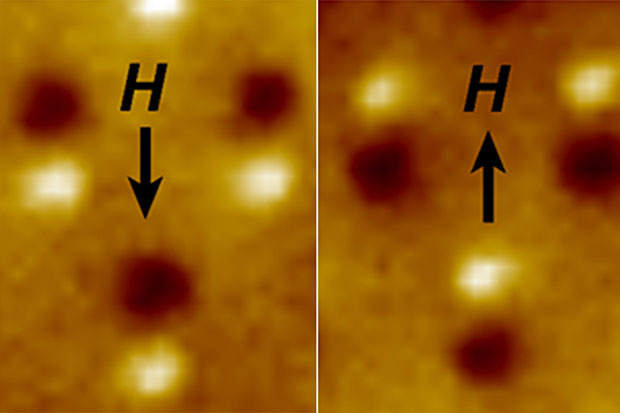

Des aimants nanométriques stockent linformation par la direction du champ magnétique de laimant. Avec un champ magnétique externe, les chercheurs ont pu inverser lorientation du champ des aimants. En mesurant très précisément lintensité et lorientation du champ de laimant en fonction du champ extérieur, ils ont pu déterminer que cette opération consommait en moyenne six zeptajoules à température ambiante, soit le double de la limite de Landauer (sans compter, donc, la génération du champ utilisé pour manipuler les aimants). Léquipe estime que la différence par rapport à la limite théorique est principalement due à de légères variations dans lorientation des nanoaimants : en effet, selon des simulations numériques, des nanoaimants idéaux atteignent exactement cette limite.

Cependant, ces progrès nauront aucun impact sur les transistors utilisés dans les processeurs grand public à court terme, ni probablement à moyen terme : cette expérience marque un pas dans le passage entre la recherche fondamentale en physique et la recherche appliquée dans les transistors, mais il reste encore de nombreuses années avant une arrivée sur le marché.

Source (y compris limage) et plus de détails : Zeptojoule Nanomagnetic Switch Measures Fundamental Limit of Computing.

Ce contenu a été publié dans Matériel par dourouc05.

Vous avez lu gratuitement 39 articles depuis plus d'un an.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.

Soutenez le club developpez.com en souscrivant un abonnement pour que nous puissions continuer à vous proposer des publications.

) ?

) ?